Vera Rubinプラットフォームってどんなもの?

NVIDIA Vera Rubinプラットフォームは、まさにAIの未来を形作るための基盤となる存在です。このプラットフォームには、以下の7つの画期的なチップが統合されています。

-

NVIDIA Vera CPU

-

NVIDIA Rubin GPU

-

NVIDIA NVLink™ 6 Switch

-

NVIDIA ConnectX®-9 SuperNIC

-

NVIDIA BlueField®-4 DPU

-

NVIDIA Spectrum™-6 Ethernet スイッチ

-

NVIDIA Groq 3 LPU

これらのチップは、ただ単体で高性能なだけでなく、まるで1つの巨大なAIスーパーコンピューターのように連携するように設計されています。これにより、AIモデルの大規模な事前トレーニング、トレーニング後の調整、テスト時のスケーリング、そしてリアルタイムのエージェント型推論まで、AI開発のあらゆる段階を強力にサポートします。

NVIDIAの創業者兼CEOであるジェンスン フアン氏は、「Vera Rubinは、世代を超えた飛躍です。画期的な7つのチップ、5つのラック、1つの巨大なスーパーコンピューターが、AIのあらゆる段階を支えるために構築されています。Vera Rubinがけん引する史上最大のインフラ構築を開始したことで、エージェント型AIの転換期が到来しました」と述べています。この言葉からも、NVIDIAがこのプラットフォームにかける大きな期待が伺えます。

AIインフラの進化:PODスケール システムへの移行

現代のAIインフラは、かつての個別のチップや単独のサーバーから、完全に統合されたラックスケールシステム、さらにはPODスケールでの展開、そしてAIファクトリーやソブリンAIへと、目覚ましい進化を遂げています。このような進化は、スタートアップ企業から大企業、公的機関に至るまで、あらゆる規模の組織や業界で劇的なパフォーマンス向上とコスト効率の改善をもたらしています。

NVIDIA Vera Rubinプラットフォームは、80社以上のMGXエコシステムパートナーとグローバルなサプライチェーンによって支えられ、コンピューティング、ネットワーキング、ストレージにおける綿密な協調設計を通じて、最も広範なNVIDIA PODスケールプラットフォームを提供します。これは、AI専用に構築された複数のラックが、1つの巨大で一貫したシステムとして機能するスーパーコンピューターなのです。

この進化により、AIへのアクセスがより普及し、エネルギー効率も向上することで、世界で最も要求の厳しいAIワークロードにも対応できるようになるでしょう。

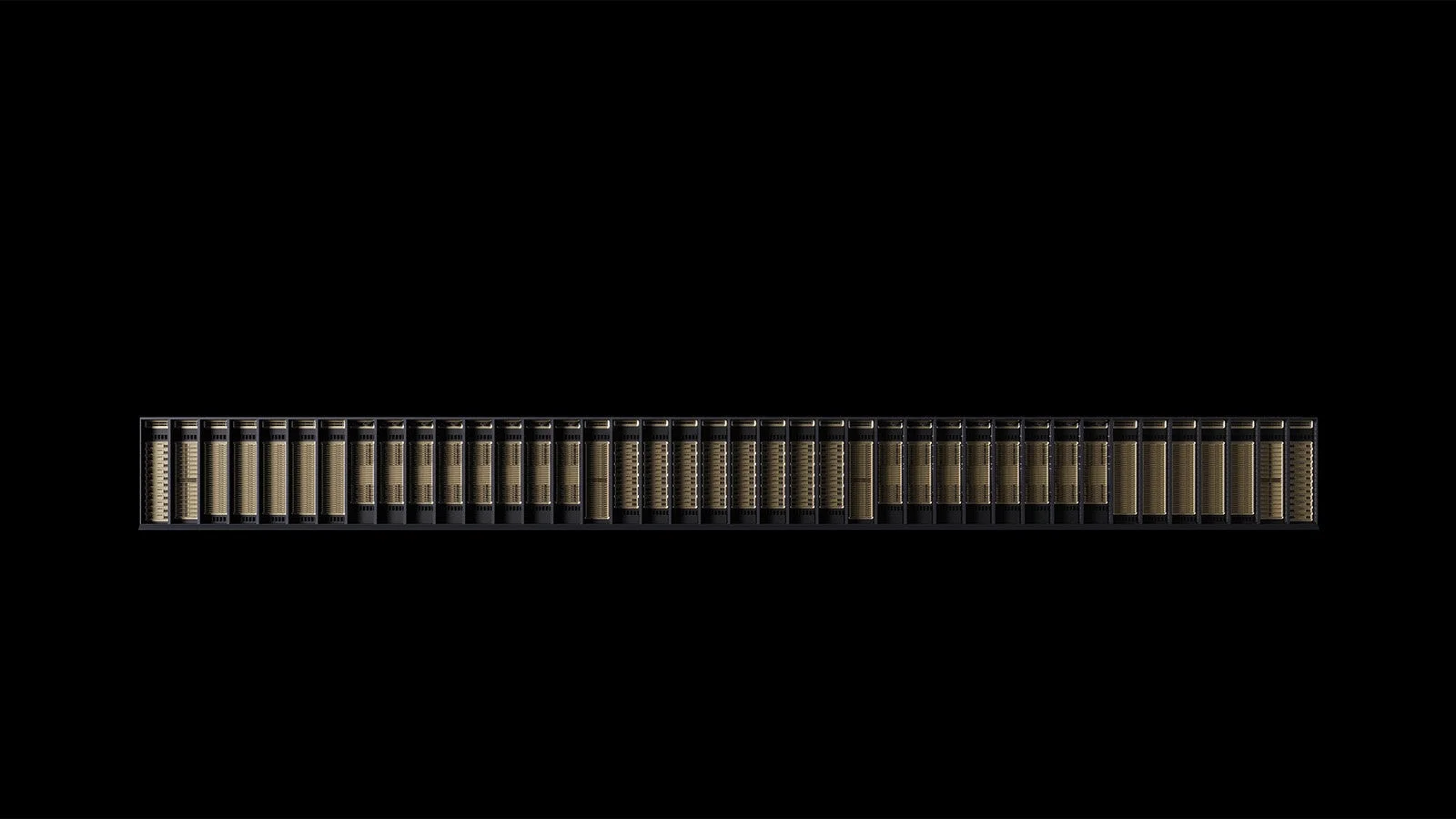

Vera Rubinプラットフォームを構成する主要なラックたち

NVIDIA Vera Rubinプラットフォームは、その高性能を支えるために、様々な役割を持つ専用ラックで構成されています。それぞれのラックがどのようにAIの進化に貢献するのか、詳しく見ていきましょう。

NVIDIA Vera Rubin NVL72 ラック

Vera Rubin NVL72ラックは、AIのトレーニングと推論において、驚異的な効率性を実現する心臓部とも言える存在です。このラックには、NVLink 6で接続された72基のRubin GPUと36基のVera CPUが統合されています。さらに、ConnectX-9 SuperNICとBlueField-4 DPUも組み込まれており、これらが連携することで、これまでの常識を覆す性能を発揮します。

具体的には、NVIDIA Blackwellプラットフォームと比較して、わずか4分の1のGPU数で大規模なエキスパート混合モデルのトレーニングが可能になるとのこと。これにより、トークンあたりのコストを10分の1に削減し、ワットあたり最大10倍高い推論スループットを達成できると期待されています。

NVL72は、世界中のハイパースケールAIファクトリー向けに設計されており、NVIDIA Quantum-X800 InfiniBandおよびSpectrum-X Ethernetとシームレスに連携することで、大規模なGPUクラスター全体で高い稼働率を維持しながら、トレーニング時間と総所有コストの削減に貢献します。

NVIDIA Vera CPU ラック

強化学習やエージェント型AIワークロードでは、GPUシステムで生成された結果をテストし、検証するために、多数のCPUベース環境が不可欠です。NVIDIA Vera CPUラックは、まさにこのニーズに応えるために設計されました。

このラックは、NVIDIA MGX上に構築された高密度の液冷インフラを提供し、最大256基のVera CPUを統合します。世界クラスのシングルスレッドパフォーマンスと拡張性、そしてエネルギー効率に優れた処理能力を提供することで、大規模なエージェント型AIの実現を強力に後押しします。

Spectrum-X Ethernetネットワーキングとの統合により、Vera CPUラックはAIファクトリー全体でCPU環境を緊密に同期させます。GPUコンピューティングラックと組み合わせることで、大規模なエージェント型AIと強化学習のための堅牢なCPU基盤を提供し、従来のCPUと比較して2倍の効率と50%の高速化を実現するとされています。

NVIDIA Groq 3 LPX ラック

NVIDIA Groq 3 LPXラックは、アクセラレーテッドコンピューティングにおける新たなマイルストーンとなるでしょう。エージェント型システムの低レイテンシかつ大規模コンテキストの要求に合わせて設計されたLPXとVera Rubinは、両プロセッサの究極のパフォーマンスを統合します。これにより、1兆パラメータモデルにおいてメガワットあたりの推論スループットを最大35倍向上させ、収益機会を最大10倍に拡大できると期待されています。

大規模な展開では、LPUフリートが高速で決定論的な推論を実現する単一の巨大なプロセッサとして機能します。256基のLPUプロセッサを搭載したLPXラックは、128GBのオンチップSRAMと640TB/sのスケールアップ帯域幅を備えています。Vera Rubin NVL72と連携して展開することで、Rubin GPUとLPUはAIモデルのすべての層を共同で計算し、出力トークンごとのデコードを加速します。

1兆パラメータのモデルと100万トークンのコンテキストに最適化され、Vera Rubinと共同設計されたLPXアーキテクチャは、電力、メモリ、コンピューティング全体の効率を最大化します。ワットあたりのスループットとトークンパフォーマンスの向上により、超プレミアムな1兆パラメータ、100万コンテキストの推論という新たな階層が開放され、すべてのAIプロバイダーの収益機会を拡大するでしょう。完全に液冷式でMGXインフラ上に構築されたLPXは、次世代のVera Rubin AIファクトリーにシームレスに統合され、今年後半に提供が開始される予定です。

NVIDIA BlueField-4 STX ストレージ ラック

ラックスケールシステムにとって、POD全体でGPUメモリをシームレスに拡張するAIネイティブなストレージインフラは非常に重要です。NVIDIA BlueField-4 STXストレージラックは、この課題に応えるために開発されました。

BlueField-4を搭載し、NVIDIA Vera CPUとNVIDIA ConnectX-9 SuperNICと組み合わせたこのシステムは、大規模言語モデル(LLM)およびエージェント型AIワークフローによって生成される大規模なKey-Value(KV)キャッシュデータの保存と取得に最適化された、高帯域幅の共有レイヤーを提供します。これにより、AIワークロードのボトルネックとなりがちなストレージ性能を大幅に改善します。

BlueField-4ストレージラックをさらに強化するのが、新しいDOCAフレームワーク「NVIDIA DOCA Memos™」です。これは専用のKVキャッシュストレージ処理を可能にし、一般的なストレージアーキテクチャと比較して、推論スループットを最大5倍向上させるとともに、電力効率を大幅に改善します。その結果、POD全体のコンテキストが可能になり、AIエージェントとの高速なマルチターンインタラクション、より拡張性のあるAIサービス、そして全体的なインフラ稼働率の向上を実現します。

Mistral AIの共同創業者兼CTOであるTimothée Lacroix氏は、「NVIDIA BlueField-4 STXラックスケールコンテキストメモリストレージシステムは、Mistral AIのエージェント型AIの取り組みを指数関数的に拡大していく上で不可欠な性能向上を実現してくれます。AIエージェントのメモリに特化して設計された新たなストレージ階層を提供することで、STXは、膨大なデータセットを対象に推論を行う際にも、Mistral AIのモデルが一貫性と高速性を維持できるようにする、理想的なソリューションとなります」とコメントしています。

詳細はこちらで確認できます: NVIDIA BlueField-4 STX Storage Architecture

NVIDIA Spectrum-6 SPX Ethernet ラック

AIファクトリーのような大規模なシステムでは、内部のデータ通信が非常に重要になります。NVIDIA Spectrum-6 SPX Ethernetラックは、AIファクトリー全体の東西トラフィックを高速化するように設計されています。

このラックは、Spectrum-X EthernetまたはNVIDIA Quantum-X800 InfiniBandスイッチで構成可能で、低レイテンシで高スループットのラック間接続を大規模に実現します。これにより、AIワークロードのパフォーマンスを最大限に引き出すための高速なデータフローが保証されます。

さらに、コパッケージドオプティクスを搭載するSpectrum-X Ethernet Photonicsは、従来のプラガブルトランシーバーと比較して、最大5倍の光電力効率と10倍のレジリエンス(耐障害性)を実現します。これは、大規模なAIインフラにおいて、電力コストの削減とシステムの安定性向上に大きく貢献する要素と言えるでしょう。

レジリエンスとエネルギー効率の向上

AIファクトリーの構築と運用では、性能だけでなく、システムの安定性とエネルギー効率も非常に重要な課題です。NVIDIAは、200社以上のデータセンターインフラパートナーと共に、Vera Rubinプラットフォーム向けのDSXを発表しました。

新しいDSXプラットフォームには、AIファクトリー全体の動的な電力プロビジョニングを可能にするDSX Max-Qが含まれています。これにより、電力供給に制限があるデータセンター内でも、AIインフラの展開を30%増加させることが可能になります。さらに、新しいDSX Flexソフトウェアは、AIファクトリーをグリッドに柔軟な資産へと変え、これまで活用されていなかった100ギガワットものグリッド電力を開放する可能性を秘めています。

NVIDIAはまた、ワットあたりのトークン数と全体的なグッドプットを最大化し、システムのレジリエンスを高め、初回の本番環境までの時間を短縮するための協調設計AIインフラのブループリント「Vera Rubin DSX AI Factory リファレンス デザイン」を公開しました。

Vera Rubin DSX AI Factory リファレンス デザイン

このアーキテクチャは、コンピューティング、ネットワーキング、ストレージ、電力、冷却を緊密に統合することで、エネルギー効率を向上させ、AIファクトリーが継続的な高負荷ワークロードの下で稼働時間を最大化しながら確実に拡張できるように設計されています。

広がるエコシステムサポート

Vera Rubinベースの製品は、今年後半にパートナーから提供開始される予定です。この画期的なプラットフォームは、業界の主要なプレイヤーたちから幅広いサポートを受けています。

主要なクラウドプロバイダーとして、Amazon Web Services、Google Cloud、Microsoft Azure、Oracle Cloud Infrastructureが名を連ねています。また、NVIDIA Cloud Partnerには、CoreWeave、Crusoe、Lambda、Nebius、Nscale、Together AIといった企業が含まれています。

グローバルなシステムメーカーでは、Cisco、Dell Technologies、HPE、Lenovo、Supermicroのほか、Aivres、ASUS、Foxconn、GIGABYTE、Inventec、Pegatron、Quanta Cloud Technology (QCT)、Wistron、Wiwynnからも、Vera Rubin製品をベースにした幅広いサーバーが提供される見込みです。

Anthropic、Meta、Mistral AI、OpenAIといったAIラボや最先端のモデル開発者たちも、NVIDIA Vera Rubinプラットフォームを活用して、より大規模で高性能なモデルをトレーニングし、従来のGPU世代よりも低レイテンシかつ低コストで長文コンテキストのマルチモーダルシステムを提供することを目指しています。

まとめ:エージェント型AIが拓く未来

NVIDIA Vera Rubinプラットフォームの登場は、エージェント型AIの分野に大きな変革をもたらすでしょう。7つの革新的なチップと、それらが一体となって機能する巨大なAIスーパーコンピューターは、AI開発のあらゆる段階で効率と性能を劇的に向上させます。これにより、より複雑なリーズニングやエージェント型のワークフロー、そしてミッションクリティカルな意思決定にAIが活用される機会が飛躍的に増えることでしょう。

エネルギー効率の向上や、広範なエコシステムによるサポートも相まって、Vera Rubinプラットフォームは、AIファクトリーの構築と運用を加速させ、世界中の企業や研究機関がAIの恩恵を最大限に享受できる未来を切り拓くことが期待されます。まさに、エージェント型AIの「転換期」が到来したと言っても過言ではありません。今後のNVIDIA Vera Rubinプラットフォームの展開に、目が離せませんね。

NVIDIAに関する詳細情報はこちらから: NVIDIA 公式ウェブサイト