エージェント型AIの未来を担うVera CPU

AIの進化は目覚ましく、特にタスクの計画、ツールの実行、データとの対話、コードの実行、結果の検証といった複雑な作業をこなす「リーズニング」と「エージェント型AI」の分野で大きな進歩が見られます。このような高度なAIモデルを支えるインフラにとって、スケール、パフォーマンス、コストは非常に重要な要素です。

NVIDIA Vera CPUは、NVIDIA Grace™ CPUの成功を土台とし、あらゆる規模や業種の組織が大規模なエージェント型AIを実現する「AIファクトリー」を構築できるように設計されています。最高のシングルスレッド性能とコアあたりの帯域幅を持つVeraは、コーディングアシスタントや消費者向け、エンタープライズ向けのエージェントなど、大規模なAIサービスにおいて、より高いAIスループット、応答性、そして効率性を提供する新しいクラスのCPUとして登場しました。

驚異的な性能と効率性

Vera CPUは、NVIDIA独自の88基のカスタムOlympusコアを搭載しています。これらのコアは、コンパイラ、ランタイムエンジン、分析パイプライン、オーケストレーションサービスに卓越したパフォーマンスを提供します。さらに、NVIDIA Spatial Multithreading技術により、各コアが2つのタスクを同時に実行できるため、多数のジョブを同時実行するマルチテナントAIファクトリーに最適な、一貫した予測可能なパフォーマンスを実現します。

エネルギー効率もVera CPUの大きな特徴です。LPDDR5Xメモリをベースとした第2世代のNVIDIA低消費電力メモリサブシステムを搭載し、最大1.2 TB/sの帯域幅を実現しています。これは汎用CPUと比較して2倍の帯域幅でありながら、消費電力は半分という驚異的な効率性を誇ります。

広がる採用とエコシステム

Vera CPUの導入に向けて、すでに多くの企業や機関がNVIDIAと連携しています。主要なハイパースケーラーとしては、Alibaba、CoreWeave、Meta、Oracle Cloud Infrastructureが名を連ねています。また、Dell Technologies、HPE、Lenovo、Supermicroをはじめとするグローバルシステムメーカーも、このテクノロジーを活用したサーバー設計を進めています。

このような広範な採用は、Veraが開発者、スタートアップ、官民機関、企業にとって最も重要なAIワークロード向けの新たなCPU標準となり、AIへのアクセスを民主化し、イノベーションを加速させることを示唆しています。

あらゆるデータセンターに対応する柔軟な設計

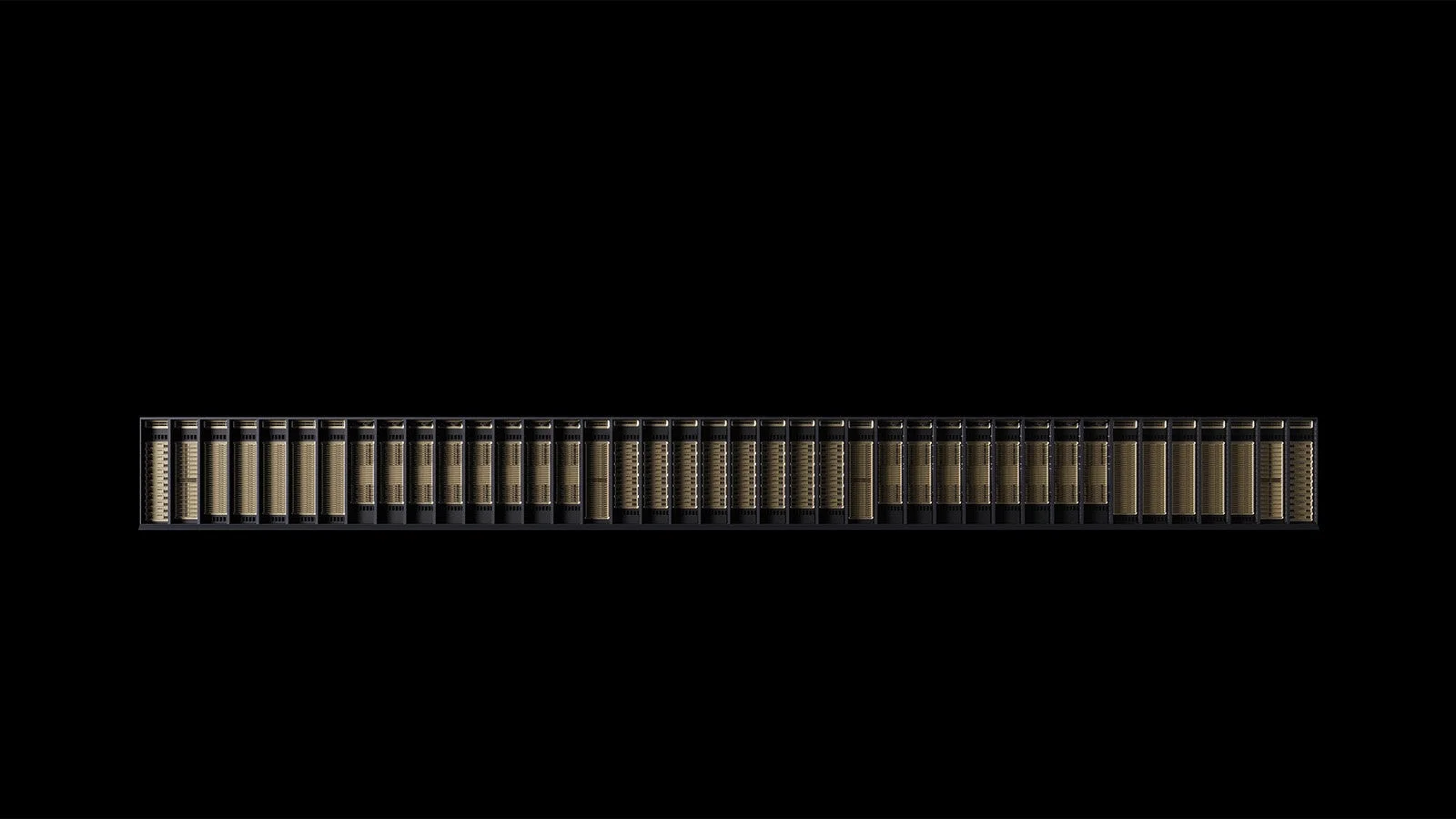

NVIDIAは、256基の液冷式Vera CPUを統合した新しいVera CPUラックも発表しました。これにより、22,500以上の同時CPU環境を維持し、各環境が独立してフルパフォーマンスで動作することが可能になります。AIファクトリーは、単一のラック内で数万もの同時インスタンスやエージェント型ツールを迅速に展開し、拡張できるでしょう。

新しいVeraラックは、NVIDIA MGX™モジュラーリファレンスアーキテクチャを採用して構築されており、世界中の80社ものエコシステムパートナーによってサポートされています。

Vera CPUは、NVIDIA Vera Rubin NVL72プラットフォームの一部として、NVIDIA NVLink™-C2Cインターコネクトテクノロジを介してNVIDIA GPUとペアリングされています。1.8 TB/sというコヒーレント帯域幅(PCIe Gen 6の7倍)により、CPUとGPU間の高速データ共有を実現します。さらに、NVIDIAは、NVIDIA HGX™ Rubin NVL8システム向けに、VeraをホストCPUとして採用した新しいリファレンスデザインを発表しており、GPUアクセラレーテッドワークロードにおけるデータの移動とシステム制御を連携させます。

Veraのシステムパートナーは、デュアルソケットCPUサーバー構成とシングルソケットCPUサーバー構成の両方でVeraを提供します。これは、強化学習、エージェント型推論、データ処理、オーケストレーション、ストレージ管理、クラウドアプリケーション、ハイパフォーマンスコンピューティングなどの幅広いワークロードに最適です。

すべての構成において、VeraはNVIDIA ConnectX® SuperNIC カードおよびNVIDIA BlueField®-4プロセッサと統合され、エージェント型AIに不可欠な高速化されたネットワーキング、ストレージ、セキュリティを実現します。これにより、顧客はプラットフォーム全体で統一されたソフトウェアスタックを維持しながら、特定のワークロードに最適化することが可能です。

実社会での活用事例と今後の展望

ストリーミングデータプラットフォーム大手のRedpandaは、Veraを活用してパフォーマンスを劇的に向上させています。RedpandaのCEO兼創業者であるAlex Gallego氏は、「Apache Kafka互換ワークロードを実行してNVIDIA Veraをテストしたところ、ベンチマークした他のシステムよりも大幅に優れたパフォーマンスを達成し、レイテンシを最大5.5倍低減しました」と述べています。Veraは、リアルタイムストリーミングワークロードの拡張や、新たなAIおよびエージェント型アプリケーションの開拓を可能にするでしょう。

Vera CPUの導入を計画している国立研究機関には、ライプニッツスーパーコンピューティングセンター、ロスアラモス国立研究所、ローレンスバークレー国立研究所の国立エネルギー研究科学計算センター、そしてテキサス先端計算センター (TACC) が含まれます。TACCのハイパフォーマンスコンピューティングディレクターであるJohn Cazes氏は、Veraのコアあたりのパフォーマンスとメモリ帯域幅が科学計算にとって飛躍的な進歩であると期待を寄せています。

さらに、Alibaba、ByteDance、Cloudflare、CoreWeave、Crusoe、Lambda、Nebius、Nscale、Oracle Cloud Infrastructure、Together.AI、Vultrなど、多くの主要クラウドサービスプロバイダーもVera CPUの導入を計画しています。インフラプロバイダーでは、Aivres、ASRock Rack、ASUS、Compal、Cisco、Dell、Foxconn、GIGABYTE、HPE、Hyve、Inventec、Lenovo、MiTAC、MSI、Pegatron、Quanta Cloud Technology (QCT)、Supermicro、Wistron、WiwynnなどがVera CPUを採用しています。

NVIDIA Veraは現在量産中で、今年後半にはパートナーから提供が開始される予定です。この革新的なCPUが、エージェント型AIの分野にどのような変化をもたらすのか、今後の動向から目が離せません。

NVIDIAの詳細については、NVIDIAのウェブサイトをご覧ください。また、GTC 基調講演のリプレイやセッションも確認できます。