生成AIの「嘘」に悩む企業、3社に1社がハルシネーションを課題と認識!

最近、ビジネスシーンで「生成AI」という言葉を聞かない日はありませんよね。ChatGPTのような大規模言語モデル(LLM)の登場で、業務効率化や新たな価値創造への期待が大きく高まっています。しかし、その裏側で、多くの企業が頭を悩ませている問題があるのをご存知でしょうか?それが「ハルシネーション」です。

「AIが自信満々に間違った情報を答えてきた」「根拠のない数字を、まるで事実かのように提示された」——きっと、あなたもそうした経験があるかもしれませんね。この「ハルシネーション(幻覚)」とは、生成AIが事実に基づかない情報を、あたかも正確であるかのように出力してしまう現象のこと。まるでAIが「嘘」をついているかのように見えるため、ビジネスの現場では深刻なリスクとして捉えられています。

なぜAIは「嘘」をついてしまうのでしょうか?

実は、ChatGPTをはじめとするLLMは、「もっともらしい文章を生成すること」を最大の目的として設計されています。残念ながら、「常に正確な情報を出力すること」は、その本質的な機能として保証されているわけではありません。AIが学習したデータの限界、文脈を完全に理解しきれない制約、そして最新情報への非対応など、さまざまな特性が組み合わさることで、ハルシネーションは発生してしまうのです。例えば、学習データに偏りがあったり、古い情報しか含まれていなかったりすると、AIは最新の事実とは異なる情報を生成してしまう可能性があります。

このような誤情報に基づいて重要な意思決定をしてしまえば、ビジネスに直接的な損失をもたらす可能性も否定できません。特に、企業の競争力を左右するような「情報収集・調査・分析」や、システムの品質に直結する「システム開発・運用」といった領域での活用が広がる中、ハルシネーションは看過できないリスクとして、その重要性が増しています。

こうした現状を定量的に把握し、企業が実践できる具体的な対策手法を明らかにするため、ラーゲイト株式会社は2025年12月に、情報システム部門・DX推進室所属のビジネスパーソン505名を対象とした「生成AI活用における出力精度・ハルシネーション実態調査」を実施しました。この調査によって、ハルシネーションが単なる「使い方の問題」ではなく、組織レベルで対処が求められる経営課題として浮上していることが判明したのです。

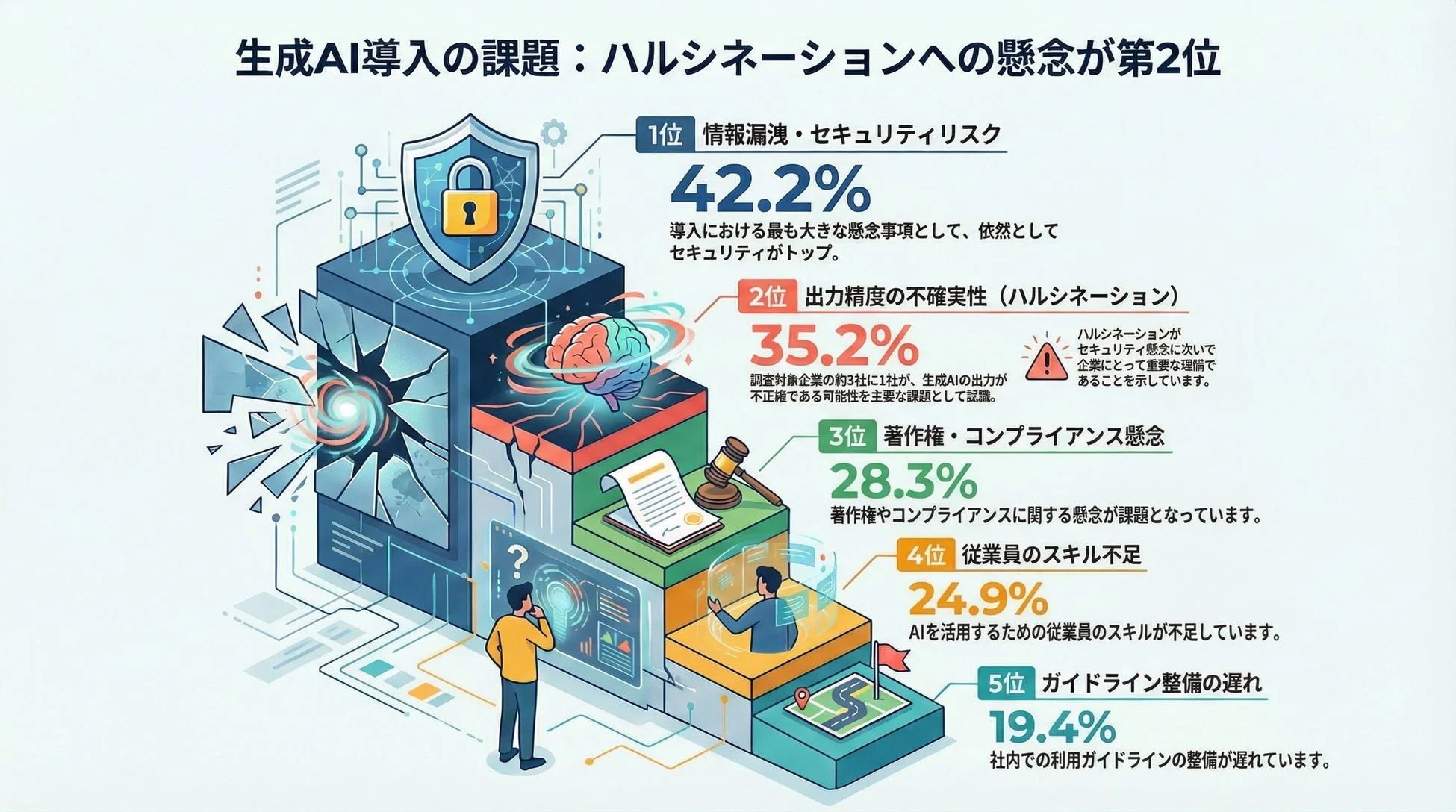

調査結果ハイライト:ハルシネーションはセキュリティに次ぐ重要課題

調査結果は、多くの企業が生成AIの「嘘」に真剣に向き合っている現状を浮き彫りにしました。生成AI導入における課題を尋ねたところ、実に35.2%もの企業が「出力精度の不確実性(ハルシネーション)」を課題と認識していることが明らかになったのです。

この数字は、以下の課題ランキングにおいて、堂々の第2位に位置しています。

-

1位:情報漏洩・セキュリティリスク(42.2%)

-

2位:出力精度の不確実性(ハルシネーション)(35.2%)

-

3位:著作権・コンプライアンス懸念(28.3%)

-

4位:従業員のスキル不足(24.9%)

-

5位:ガイドライン整備の遅れ(19.4%)

情報漏洩やセキュリティリスクが依然としてトップの懸念事項であることは理解できますが、ハルシネーションがそれに次ぐ第2位にランクインしたことは、非常に重要な意味を持ちます。これは、約3社に1社が、生成AIの出力が不正確である可能性を、業務活用を妨げる主要な課題として強く認識していることを示しているからです。AIの導入が進めば進むほど、その出力品質の管理は「IT部門の技術的な問題」から、企業全体の信頼性や競争力に直結する「経営上の喫緊の課題」へと昇格していると言えるでしょう。

単にAIを導入するだけでなく、その出力が信頼できるものなのか、誤情報によって思わぬトラブルに巻き込まれないか、といったガバナンスの視点を持つことが、これからのAI活用には不可欠です。この調査結果は、企業が生成AIを本格的に導入する上で、ハルシネーション対策が避けて通れない道であることを明確に示唆しているのです。

危険信号!情報収集・分析領域が抱える最高リスク

生成AIはさまざまな業務領域で活用されていますが、その中でも特にハルシネーションのリスクが高いとされたのはどの領域だったのでしょうか?調査では、業務領域別に活用率とハルシネーションリスクが分析され、興味深い傾向が明らかになりました。

-

情報収集・調査・分析(活用率39.2%):リスク・影響度ともに「高」

- 誤った市場データや競合情報に基づく意思決定は、ビジネスに直接的な損害をもたらす可能性があり、最高リスク領域とされました。例えば、AIが生成した間違った市場トレンド予測に基づいて新製品を開発してしまえば、多大な開発コストが無駄になるだけでなく、市場投入の機会損失にもつながりかねません。また、競合他社の誤った情報に基づいて戦略を立ててしまえば、競争優位を失うどころか、企業としての信頼性まで損なう事態も想定されます。この領域でのハルシネーションは、まさに「致命傷」になりうるのです。

-

システム開発・運用(活用率37.4%):

- AIが生成したコードにバグや脆弱性が混入するリスクがあります。そのため、人間による厳格なコードレビューが必須となります。もし見落とされれば、システムダウンやセキュリティインシデントに繋がり、企業の事業継続性にも影響を与えかねません。

-

議事録作成・要約(活用率28.1%):

- 元の音声や文書が存在するため、比較的リスクは低いとされています。しかし、AIが情報の取捨選択を誤ったり、文脈を読み違えたりすることで、重要な情報が欠落したり、誤解を招く要約が生成されたりする可能性は残ります。特に、重要な会議の議事録などでは、正確性の確認が欠かせません。

この結果から見えてくるのは、「活用率の高い領域ほど、ハルシネーションの影響範囲が広がり、そのダメージが大きくなる」という構造的な課題です。特に、企業の意思決定の根幹を担う「情報収集・分析」の領域でハルシネーションが多発すれば、それは組織全体を揺るがす事態に発展しかねません。だからこそ、この領域での対策は最優先事項となるわけです。

ハルシネーション対策の切り札「RAG」とは?ノーコードで実現する未来

では、この厄介なハルシネーション問題に、私たちはどう立ち向かえば良いのでしょうか?調査では、ハルシネーションを低減させるための最も根本的かつ効果的な手法として、「RAG(Retrieval-Augmented Generation:検索拡張生成)」の導入が挙げられています。

RAGとは、簡単に言えば、LLMが回答を生成する際に、事前に信頼できる情報源(例えば、企業の社内ナレッジベース、公式文書、特定のデータベースなど)から関連情報を「検索」し、その検索結果を「参照」しながら回答を「生成」させる技術のこと。これにより、LLMは自身の学習データだけに頼るのではなく、最新かつ正確な情報に基づいて回答を組み立てることができるため、ハルシネーションの発生を大幅に抑えることが可能になります。まるで、AIに「ちゃんと調べてから答えてね」と指示するようなイメージですね。

RAG以外にも、ハルシネーション対策として有効なアプローチはいくつかあります。

-

ファクトチェック体制の構築:AIが生成した出力に対して、自動検証を行い、最終的には人間が内容をレビュー・修正・承認するという段階的なプロセスを整備することが重要です。これにより、AIの誤情報を人間が食い止める「最後の砦」となります。

-

プロンプトエンジニアリングの最適化:AIへの指示(プロンプト)を工夫することも非常に効果的です。「分からない場合は『分かりません』と回答してください』」や「不確かな部分には【要確認】と記載してください」など、AIに制約条件を明確に伝えることで、無責任な回答を防ぐことができます。プロンプトは、AIとのコミュニケーションを円滑にするための「魔法の言葉」のようなものなのです。

-

用途別のモデル選定:全てのタスクに同じLLMが最適とは限りません。事実確認を重視するタスクにはより信頼性の高いモデルを、コストを重視するタスクには効率的なモデルを、日本語に特化したタスクには日本語に強いモデルを選ぶなど、用途に応じた最適なモデルを使い分けることが賢明です。

-

継続的なモニタリングと改善:ハルシネーションの発生率や、ファクトチェックでの修正率などをKPI(重要業績評価指標)として設定し、定期的にモニタリングすることが大切です。これにより、対策の効果を測定し、PDCAサイクルを回しながら継続的に改善していくことができます。

そして、このRAG導入を現実的なものにするとして注目されているのが、DifyやAmazon Bedrockといったノーコードツールの活用です。これまで、RAG環境を構築するには高度なエンジニアリングスキルが必要でしたが、Difyを使えば、専門知識がなくてもノーコードでRAGアプリケーションを構築できるようになりました。さらに、Amazon Bedrockと連携させることで、AWS上でセキュアにホスティングすることが可能になります。

これは何を意味するかというと、企業が抱える上位2大課題である「セキュリティ懸念(42.2%)」と「ハルシネーション懸念(35.2%)」を同時に解消する道筋が生まれているということ。ノーコードでRAGが構築できれば、より多くの企業が手軽に、かつ安全に生成AIを活用できるようになるはずです。まさに「対策の民主化」が実現されようとしているのです。

ラーゲイトが描く未来:AI活用は「品質担保」のフェーズへ

今回の調査結果が私たちに伝える最も重要なメッセージは、「ハルシネーションは完全にゼロにすることは難しいけれど、許容できる範囲内にコントロールすることは十分に可能である」という事実です。

35.2%という数字は、単なる「不満の声」ではありません。それは、生成AIの活用が本格化するにつれて顕在化してきた、企業ガバナンス上の重要な課題なのです。生成AIを業務に組み込む企業が増えれば増えるほど、その出力品質の管理は、もはや「IT技術の問題」という枠を超え、「経営戦略の根幹をなす問題」へとその位置付けを変えていくでしょう。

特に、意思決定の材料として生成AIを活用する頻度が高い情報システム部門やDX推進室においては、品質管理の仕組みを他社に先駆けて整備することが、そのまま企業の競争優位の源泉になり得ると考えられます。信頼性の高い情報に基づいた迅速な意思決定は、市場での優位性を確立するための強力な武器となるからです。

ラーゲイト株式会社が特に注目しているのは、RAGとノーコードツールの組み合わせによる「対策の民主化」です。これまで、RAG環境の構築には高度なエンジニアリングスキルが不可欠で、導入のハードルが高いと感じる企業も少なくありませんでした。しかし、Difyのようなツールを活用することで、専門的な知識がなくてもRAG環境をノーコードで実現できるようになりました。これは、多くの企業にとって画期的な進展と言えるでしょう。さらに、Amazon Bedrockとの連携により、AWS上でセキュアな環境でRAGをホスティングできるため、セキュリティ面での懸念も同時に解消できる道筋が見えてきています。

今後の展望として、企業のAI活用は「生成AIを使うかどうか」という初期の議論から、「生成AIの品質をいかに担保しながら業務に組み込んでいくか」という、より高度なフェーズへと移行していくと予測されます。ハルシネーション対策を自社で内製化し、AIの出力品質を適切に管理できる企業と、そうでない企業の間には、意思決定の精度や業務品質の面で、きっと顕著な差が生まれることでしょう。この差が、企業の未来を左右すると言っても過言ではありません。

ラーゲイト株式会社のAI活用支援サービス

ラーゲイト株式会社は、企業のAI活用におけるこれらの課題に対し、具体的なソリューションを提供しています。AWS FTR認定取得済みの専門チームが、DifyによるRAG環境構築からAWS上でのセキュアホスティング、さらには社内人材のリスキリングまでを、一気通貫で支援してくれます。「RAGを導入したいけれど、具体的にどうすれば良いか分からない」「信頼性の高いAIチャットボットを社内に構築して、業務に役立てたい」といったお悩みをお持ちの企業は、いつでも相談できるそうです。

ラーゲイト株式会社では、以下のようなサービスを通じて、企業のAI活用とDX推進を力強くサポートしています。

調査レポートの詳細はこちらからご覧いただけます。

調査レポート詳細

ラーゲイト株式会社 企業情報

-

コーポレートサイト: https://www.ragate.co.jp/

-

代表取締役: 益子 竜与志

-

設立: 2017年5月25日

-

電話番号: 050‐5527‐2670

-

資本金: 21,000,000円

まとめ:AIと賢く付き合うための第一歩

生成AIは、私たちのビジネスに革命をもたらす可能性を秘めた、まさに「魔法のツール」です。しかし、その「魔法」には、時に「幻覚」という副作用が伴うことも忘れてはなりません。今回の調査で明らかになったように、ハルシネーションは多くの企業にとって無視できない重要な課題であり、適切な対策が不可欠です。

RAGのような技術を導入し、ファクトチェック体制を整え、プロンプトを最適化するなど、多角的なアプローチでハルシネーションをコントロールすることは可能です。特に、DifyやAmazon Bedrockといったノーコードツールを活用すれば、これまでハードルが高かったRAG導入も、より身近なものとなるでしょう。

これからの時代、AIを「使う」だけでなく、「賢く、そして安全に使いこなす」ことが、企業の競争力を左右する重要な要素となります。ぜひ、この機会に自社のAI活用におけるハルシネーション対策を見直し、信頼性の高いAIシステムを構築するための一歩を踏み出してみてはいかがでしょうか。ラーゲイト株式会社のような専門家を頼ることも、その強力な後押しとなるはずです。